编译/VR陀螺

近日,苹果一项新视线校正系统专利曝光,旨在大幅提升AR眼镜、头显等XR设备的视线追踪精度。该发明重点用于校正眼动追踪系统在估算用户实际注视方向时存在的根本性误差。

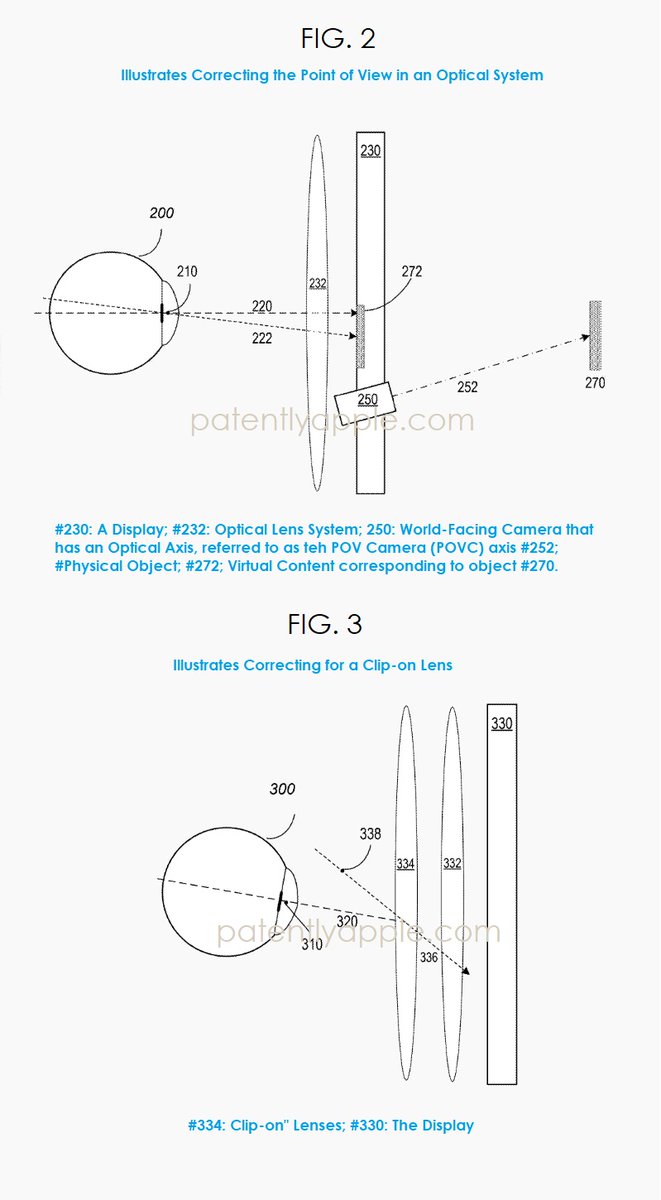

当前XR设备通常采用红外眼动追踪技术,通过构建用户眼部结构模型来实现追踪。这类系统依靠一条穿过眼球中心与瞳孔的几何线,即光轴来估算视线方向。尽管该方法有效,但存在一个重大局限:光轴并不等同于视轴,而视轴才是人眼真正的视觉方向。

当XR系统判断用户在屏幕或虚拟场景中的注视点时,这一差异会造成微小但影响显著的误差。苹果的这项发明提出了一种估算真实视轴的方法,并利用它实时校正视线追踪结果。

该方案有望显著提升未来苹果XR硬件中眼控交互、物体选择与视线驱动渲染的精准度。

苹果在其专利中指出,该技术在设备初始化阶段会增加一段校准流程,用于确定眼球光学结构与用户实际视线之间的真实对应关系。

在校准过程中,系统将:

获得校正后的视轴后,XR设备可在正常使用中调整渲染与视线计算,使虚拟内容更精准地匹配用户实际注视位置。

通过估算真实视轴,而非单纯依赖光轴,系统可减少系统性视线追踪误差,显著提升以下场景精度:

在AR或MR环境中,虚拟物体必须与现实世界元素完美贴合。这套校正系统可确保虚拟叠加层精准出现在用户预期位置。

该发明还有一个实用亮点是支持外挂矫正镜片。许多XR头显需要加装近视镜片,而这会干扰光路。

苹果方案会建模这类镜片的光学特性,并模拟光线穿过镜片的路径,即便加装额外镜片,系统仍能计算出校正后的视线轴与入射瞳孔。这保证了无论用户是否佩戴矫正镜片,视线精度始终稳定。

校准完成后,设备在运行过程中会持续将测量到的视线方向转换为校正后的视轴,该校正与虚拟内容的生成和显示同步进行。系统可在XR渲染中逐帧调整视线估算结果。

该技术还能提升XR系统对镜片光学畸变的补偿能力。通过估算校正后的入射瞳孔,系统可在显示前更精准地预扭曲图像,使其在人眼看来无畸变。

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息